Threat Hunting e Threat Intelligence: dalla frammentazione alla catena integrata

Cybersec e dintorni

Durante l’evento “Sovranità Digitale e Cybersecurity” dello scorso dicembre 2025, è stato sottolineato come Threat Hunting, Threat Intelligence e AI debbano essere integrati in una catena informativa continua, piuttosto che operare come funzioni isolate. Storicamente, il threat hunting è nato come attività operativa per individuare minacce nascoste nei sistemi, mentre la threat intelligence è una funzione strategica di analisi del panorama delle minacce. La separazione di queste funzioni ha creato un gap: i segnali tecnici prodotti dai threat hunter non raggiungono chi deve prendere decisioni, mentre le informazioni strategiche restano scollegate dall’operatività.

La maturazione del settore ha mostrato che l’efficacia dipende dalla capacità di collegare queste fasi in un processo strutturato, che trasforma dati grezzi in intelligence azionabile. L’AI ha accelerato questa integrazione, permettendo di processare volumi di dati altrimenti ingestibili, ma introduce anche nuove criticità che richiedono competenze umane per essere gestite correttamente.

Le organizzazioni raccolgono enormi quantità di dati di sicurezza, generando data lake che, senza governance costante, degenerano rapidamente in data swamp, archivi inutilizzabili. L’errore comune è pensare che l’AI possa correggere autonomamente questi dati: in realtà, amplifica i difetti strutturali. Il principio “garbage in, garbage out” è più insidioso con l’AI, perché i modelli producono output coerenti apparentemente validi anche se basati su dati compromessi, propagando bias, correlazioni spurie e allucinazioni. La gestione della qualità dei dati è quindi cruciale per l’affidabilità dell’intera pipeline.

I sistemi di AI presentano tassi di errore intrinseci: bias statistico, correlazioni spurie, allucinazioni dei modelli generativi e incertezza statistica. Questi limiti non sono difetti temporanei, ma proprietà strutturali che devono essere comprese per utilizzare efficacemente l’AI in cybersecurity.

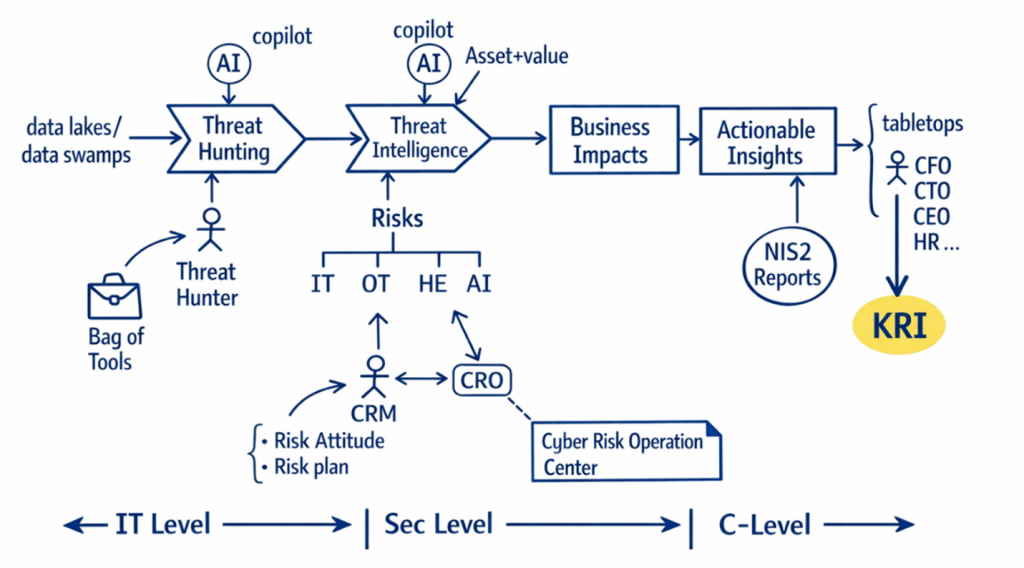

La catena operativa nella gestione delle informazioni sulle minacce collega tre livelli organizzativi (come mostra la figura successiva): IT Level, Sec Level e C-Level.

Al livello IT, i threat hunter analizzano log, eventi di rete e comportamenti di sistema per individuare anomalie, ora supportati dall’analisi comportamentale dell’AI, che riduce il dwell time delle minacce avanzate. L’AI filtra il rumore, ma la verifica umana resta indispensabile per distinguere tra falsi positivi e minacce reali.

Figura 1 – La figura mostra come si collegano tre livelli operativi: Threat Hunting, Threat Intelligence e Business Impact per produrre Actionable Insights

Questi segnali alimentano la threat intelligence, trasformando dati tecnici in informazioni contestualizzate. L’AI automatizza la classificazione dei dati e l’estrazione di TTP (Tactics, Techniques, Procedures) dai report usando framework standardizzati come MITRE ATT&CK, permettendo agli analisti di concentrarsi sulle valutazioni prioritarie. Tuttavia, i modelli presentano limiti semantici: senza supervisione umana, possono produrre classificazioni errate che contaminano le basi informative.

Il livello strategico richiede la traduzione dei dati tecnici in Business Impact e Actionable Insights: quali minacce hanno effetti reali sull’operatività, la reputazione o la compliance aziendale? Queste informazioni guidano decisioni concrete su investimenti, policy, formazione e audit, producendo Key Risk Indicators comprensibili al management. La funzione del Chief Risk Officer è critica per collegare intelligence tecnica e decisioni strategiche, garantendo che il C-Level operi su basi analitiche piuttosto che percezioni.

L’AI amplifica capacità umane in ogni fase della catena, ma non elimina la necessità di competenze qualificate. Tre limiti operativi chiave devono essere sempre considerati: la manutenzione continua dei modelli e delle mappature, il rischio di dequalificazione degli analisti se si affidano ciecamente all’AI, e l’alert fatigue, che richiede calibrazione accurata per evitare che gli allarmi critici vengano ignorati. La sostenibilità della catena operativa richiede impegno costante in budget, formazione e governance.

In conclusione, la catena Threat Hunting → Threat Intelligence → Business Impact → Actionable Insights non è una sequenza tecnologica ma un processo organizzativo che unisce competenze tecniche, di sicurezza e strategiche. L’AI è uno strumento potente, ma va usata con giudizio e supervisionata, all’interno di flussi informativi definiti. La direzione evolutiva non è l’automazione totale, ma l’amplificazione intelligente delle capacità umane: le organizzazioni che investono solo in tecnologia senza sviluppare competenze falliscono, mentre quelle che integrano AI in processi strutturati trasformano i dati in intelligence reale. La vera domanda non è se adottare l’AI, ma come mantenere l’intelligenza umana necessaria a guidarla.

Un articolo più esteso in cui Enrico Frumento, Cybersecurity Research Lead di Cefriel approfondisce le relazioni che intercorrono tra i diversi ambiti del Threat hunting e della Threat intelligence, la necessità di collegarle tra loro in una catena informativa e decisionale integrata, l’apporto corretto fornito dall’AI in questo contesto, è disponibile sul canale cybersecurity di TIG:

THREAT HUNTING E THREAT INTELLIGENCE: LA CATENA CHE TRASFORMA I DATI IN DECISIONI.

Enrico Frumento

Cybersecurity Research Lead, Cefriel

![]()